Letztes Jahr hat Facebook zwei Chatbots erstellt und sie gebeten, miteinander zu sprechen und ihre Verhandlungsfähigkeiten zu üben. Wie sich herausstellte, konnten die Bots ziemlich gut verhandeln - aber sie verwendeten ihre eigene erfundene Sprache, die für Menschen unverständlich war.

Verwandte Inhalte

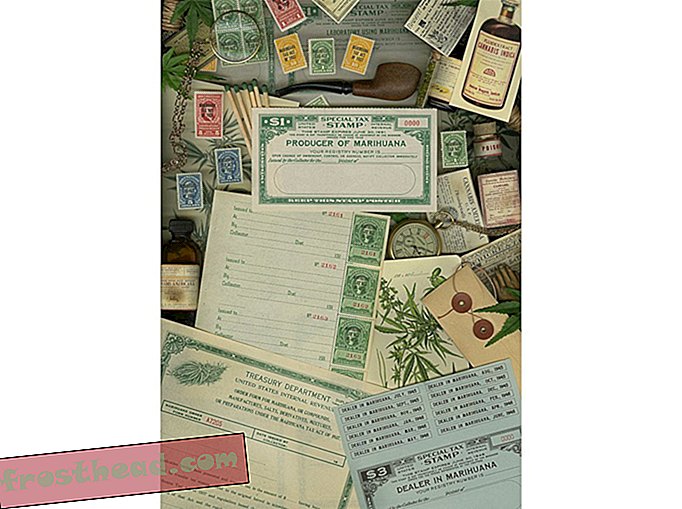

- Dieser Künstler wohnt in der geheimen Welt der geheimen Geheimnisse und der Überwachung

Hier geht die Welt hin. Computer erstellen Inhalte füreinander, nicht für uns. Bilder werden von Computern aufgenommen, damit andere Computer sie anzeigen und interpretieren können. Es geschieht alles ruhig, oft ohne unser Wissen oder unsere Zustimmung.

Das Lernen, wie man wie ein Computer sieht - diese Kommunikation von Maschine zu Maschine sichtbar zu machen - kann die wichtigste Fähigkeit des 21. Jahrhunderts sein.

Am 25. Oktober 2018 spielten das Kronos Quartet - David Harrington, John Sherba, Hank Dutt und Sunny Yang - ein Konzert im Smithsonian American Art Museum. Sie wurden von 400 Menschen und einem Dutzend Algorithmen für künstliche Intelligenz beobachtet, die letztere mit freundlicher Genehmigung von Trevor Paglen, dem Künstler hinter der Ausstellung "Sites Unseen", die derzeit im Museum zu sehen ist.

Während die Musiker spielten, zeigte ein Bildschirm über ihnen den Menschen, was die Computer sahen.

Während Kronos sich durch ein trauriges Stück arbeitete, das ursprünglich aus dem Osmanischen Reich stammte, erkannten Overhead - Algorithmen auf dem Bildschirm die Gesichter der Musiker, umrissen Lippen, Augen und Nase für jede Person (und sahen gelegentlich "Geistergesichter", in denen es keine gab - häufig in Kronos Gründer Harringtons Haarschopf). Als die Algorithmen weiterentwickelt wurden, verblasste der Video-Feed, bis nur noch Neonlinien auf schwarzem Hintergrund zu sehen waren. Schließlich verschwanden die Umrisse des Gesichts, bis nur noch eine abstrakte Linienanordnung übrig war - vermutlich alles, was der Computer brauchte, um "Gesicht" zu verstehen, aber für den Menschen völlig unverständlich.

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)

"Sight Machine", Trevor Paglen, Kronos Quartett (Bruce Guthrie)  "Sight Machine", Trevor Paglen, Kronos Quartet

"Sight Machine", Trevor Paglen, Kronos Quartet Das Ostküstendebüt der Darbietung mit dem Titel "Sight Machine" forderte Zuschauer und Zuhörer auf, zu lernen, wie man wie Computer sieht, und das menschliche Verhältnis zur Technologie - die Telefone in unserer Tasche und die Augen in der Tasche - neu zu untersuchen der Himmel und alles dazwischen.

Wir schreiben das Jahr 2018 und die Vorstellung, dass uns Handys beobachten, fühlt sich nicht mehr wie eine Verschwörungstheorie an, die von einem Basement-Blogger aufgestellt wurde, der einen Hut aus Alufolie trägt. Google wurde Anfang des Jahres beim Nachverfolgen der Standorte von Android-Handynutzern erwischt, auch wenn Nutzer die Funktion deaktiviert haben. Viele Menschen sind davon überzeugt, dass unsere Telefone uns zuhören, um Werbung besser zu schalten. Facebook und andere Unternehmen bestreiten diese Gebühren, obwohl dies technisch und rechtlich möglich ist. Die technischen Journalisten Alex Goldman und PJ Vogt haben nachgeforscht und das Gleiche herausgefunden: Es gibt keinen Grund, warum unsere Telefone nicht zuhören würden, aber auf der anderen Seite können Werbetreibende mithilfe anderer Methoden genügend Informationen über uns abrufen, die sie einfach nicht benötigen .

In diesem Zusammenhang wurde "Sight Machine" aufgeführt. Die rund ein Dutzend Kameras, die das Kronos Quartet verfolgen, haben ein Live-Video von der Aufführung an ein Computer-Rack gesendet, das handelsübliche Algorithmen für künstliche Intelligenz verwendet, um die unheimlichen Bilder zu erstellen. Die Algorithmen sind die gleichen, die in unseren Telefonen verwendet werden, um bessere Selfies zu erzielen, solche, die von selbstfahrenden Autos verwendet werden, um Hindernissen auszuweichen, und solche, die von Strafverfolgungsbehörden und Waffenführern verwendet werden. Während die Ergebnisse auf dem Bildschirm manchmal wunderschön oder sogar lustig waren, gab es eine Unterströmung von Entsetzen.

"Ich bin erstaunt über diese besondere Arbeit, weil er uns etwas zeigt, das - und das gilt für alle seine Arbeiten - uns etwas beunruhigendes zeigt und das er mit Tricks macht", sagt John Jacob, der Kurator des Museums für Fotografie, die "Sites Unseen" organisierte.

"Es ist ein bewusster Trick", sagt er, "und es funktioniert."

Später beurteilten hochentwickelte Gesichtserkennungsalgorithmen die Mitglieder von Kronos und zeigten ihre Ergebnisse auf einem Bildschirm an. "Dies ist John [Sherba]. John ist zwischen 24 und 40 Jahre alt", sagte der Computer. "Sunny [Yang] ist zu 94, 4% weiblich. Sunny ist zu 80% wütend und zu 10% neutral."

"Ich hoffe, die Aufführung zeigt unter anderem, dass die Wahrnehmung der Computer nicht neutral ist", sagt Paglen. "Sie ist stark voreingenommen ... bei allen möglichen politischen und kulturellen Annahmen." nicht neutral. " Wenn das Geschlechterklassifizierungssystem besagt, dass Sunny Yang zu 94, 4 Prozent weiblich ist, bedeutet dies, dass jemand zu 100 Prozent weiblich ist. "Und wer hat entschieden, was zu 100 Prozent weiblich ist? Ist Barbie zu 100 Prozent weiblich? Und warum ist Geschlecht eine Binärdatei?" Fragt Paglen. "Zu sehen, dass dies in einem Moment geschieht, in dem die Bundesregierung versucht, queergeschlechtliche Menschen buchstäblich auszulöschen, ist einerseits lustig, aber für mich auch schrecklich."

Ein späterer Algorithmus verzichtete auf die Prozentsätze und bewegte sich, um einfach Objekte in der Szene zu identifizieren. "Mikrofon. Violine. Person. Qualle. Perücke." (Die beiden letzteren sind eindeutig Fehler. Der Algorithmus scheint Hank Dutt für eine Qualle und Harringtons echtes Haar für ein Toupet verwirrt zu haben.) Dann wurden die Klassifizierungen komplexer. "Sunny hält eine Schere in der Hand", sagte die Maschine, als Licht von ihren Cellosaiten funkelte. "John hält ein Messer." Was würde passieren, wenn der Klassifikator diese - falschen - Informationen an die Strafverfolgungsbehörden weitergibt? Wir werden es nie erfahren.

Die meisten Endbenutzer von KI-Plattformen, die keine Künstler sind, argumentieren möglicherweise, dass diese Systeme ihre eigenen Vorurteile haben, aber immer eine endgültige Genehmigung durch einen Menschen erhalten. Ein von Amazon entwickelter Algorithmus, Rekognition, den das Unternehmen an die Strafverfolgung und möglicherweise an ICE verkauft, hat 28 Kongressmitglieder als Personen, die eines Verbrechens angeklagt wurden, fälschlicherweise identifiziert, indem sie ihre Gesichter mit Fahndungsfotos in einer öffentlich zugänglichen Datenbank verglichen haben. Zu der Zeit argumentierte Amazon, dass die ACLU, die das System zur Erstellung der Übereinstimmungen verwendete, die Erkennung nicht korrekt verwendet habe. Das Unternehmen gab an, dass die als "Konfidenzschwelle" bezeichnete Standardeinstellung des Systems für Übereinstimmungen nur 80 Prozent beträgt. (Mit anderen Worten, der Algorithmus war sich nur zu 80 Prozent sicher, dass der Abgeordnete John Lewis ein Verbrecher war.) Ein Sprecher von Amazon gab an, dass Polizeibehörden die Verwendung einer Vertrauensschwelle von 95 Prozent empfehlen und dass "die Amazon-Erkennung fast ausschließlich zur Unterstützung verwendet wird Grenzen Sie das Feld ein und erlauben Sie den Menschen, Optionen schnell zu prüfen und zu prüfen, indem Sie sie beurteilen. “Computer kommunizieren möglicherweise miteinander, aber sie bitten die Menschen vorerst immer noch, den letzten Anruf zu tätigen.

Die Musik, die Paglen unter Einbeziehung von Kronos ausgewählt hat, hat auch etwas über Technologie zu sagen. Ein Stück, "Powerhouse" von Raymond Scott, ist "wahrscheinlich am berühmtesten für die Verwendung in Cartoons in Fabrikszenen", sagt Paglen. "Wenn du jemals eine Fabrik siehst, die überproduziert und verrückt wird, ist dies oft die Musik, die dazu spricht. Für mich ist es eine Art, über diese fast karikaturistische Industrialisierung nachzudenken und sie in einen technologischen Kontext zu stellen." Ein weiteres Stück, "Different Trains" von Steve Reich, schloss das Set. Kronos spielt nur den ersten Satz, der sich mit Reichs Kindheit in den 1930er und 40er Jahren befasst. Laut Paglen zelebriert das Stück "ein Gefühl von Überschwang und Fortschritt, das die Züge ermöglichen". *

Es wurde mit Bildern aus einer öffentlich zugänglichen Datenbank namens ImageNet gekoppelt, mit denen Computern beigebracht wird, was Dinge sind. (Auch "Trainingsdaten" genannt, also ist es ein Wortspiel.) Auf dem Bildschirm blitzten Bilder unglaublich schnell auf und zeigten Beispiele von Obst, Blumen, Vögeln, Hüten, stehenden Menschen, gehenden Menschen und springenden Menschen und Personen wie Arnold Schwarzenegger. Wenn Sie einem Computer beibringen möchten, wie man eine Person wie Schwarzenegger, ein Haus oder das Konzept des "Abendessens" erkennt, zeigen Sie zunächst einem Computer diese Tausenden von Bildern.

Es gab auch kurze Videoclips von Menschen, die sich küssten, umarmten, lachten und lächelten. Vielleicht wäre eine auf diesen Bildern trainierte KI eine wohlwollende, freundliche.

Bei "Different Trains" geht es jedoch nicht nur um Optimismus. In den späteren Sätzen, die Kronos am Donnerstag nicht gespielt hat, die jedoch von den ersten "impliziert" wurden, geht es darum, wie das Versprechen der Zugfahrt als Instrument des Holocaust eingesetzt wurde. Züge, die wie technologischer Fortschritt wirkten, wurden zu Fahrzeugen, in denen Zehntausende Juden in Vernichtungslager verlegt wurden. Was wie eine wohlwollende Technologie schien, wurde für das Böse untergraben.

"Es ist wie 'Was könnte möglicherweise schief gehen?" Paglen sagt. "Wir sammeln alle Informationen über alle Menschen auf der Welt."

Und als "Different Trains" endete, verschob sich der Fokus. Auf dem Bildschirm wurden keine Bilder von Kronos oder Trainingsdaten von ImageNet mehr angezeigt. Stattdessen wurde ein Live-Video-Feed des Publikums gezeigt, bei dem die Gesichtserkennungsalgorithmen die Merkmale der einzelnen Personen auswählten. Wahrlich, selbst wenn wir glauben, nicht beobachtet zu werden, sind wir es.

In einem Live-Video-Feed des Publikums haben Algorithmen zur Gesichtserkennung die Merkmale der einzelnen Personen ausgewählt. (Bruce Guthrie)

In einem Live-Video-Feed des Publikums haben Algorithmen zur Gesichtserkennung die Merkmale der einzelnen Personen ausgewählt. (Bruce Guthrie) Um diese Geschichte zu berichten, verließ ich mein Haus und ging zur U-Bahn-Station, wo ich eine mit meinem Namen verknüpfte elektronische Karte scannte, um durch das Drehkreuz zu gehen, und wieder, als ich die U-Bahn-Innenstadt verließ. In der Innenstadt passierte ich ein halbes Dutzend Sicherheitskameras, bevor ich das Museum betrat, in dem ich mindestens zwei weitere entdeckte (ein Smithsonian-Sprecher sagt, dass der Smithsonian keine Gesichtserkennungstechnologie verwendet; die Polizeiabteilung der Metropolregion DC sagt dasselbe über seine Kameras).

Ich habe Interviews mit meinem Telefon aufgezeichnet und die Audiodaten zu einem Transkriptionsdienst hochgeladen, der mithilfe von KI herausfindet, was ich und meine Probanden sagen und ob ich auf der Grundlage des Inhalts der Interviews Werbung für mich schalten möchte oder nicht. Ich habe E-Mails mit Google Mail gesendet, in denen alles, was ich sende, "gelesen" wird (obwohl keine Anzeigen mehr für mich geschaltet werden).

Während des Berichterstattungsprozesses, als ich durch die Stadt lief, stieß ich auf das Google Street View-Auto - ich denke mir das nicht aus. Zweimal. Es ist keine Paranoia, wenn sie dich wirklich beobachten, oder?

Was bleibt also in dieser Welt, in der Computer das Sehen übernehmen und möglicherweise Urteile über uns fällen? "Sight Machine" fordert uns auf zu lernen, wie man wie ein Computer denkt - aber es erinnert uns auch daran, dass es einige Teile von uns gibt, die vorerst noch vollständig menschlich sind.

Musik, sagt Paglen, "ist etwas, das wirklich nicht quantifizierbar ist. Wenn Sie ein Computer-Vision-System beobachten, das im Wesentlichen Interpreten befragt, zeigt es mir wirklich, dass die Wahrnehmungen zwischen der Art und Weise, wie wir Kultur und Emotion und Bedeutung wahrnehmen, sehr unterschiedlich sind. und all die Arten, in denen diese für autonome Systeme unsichtbar sind. "

Oder, wie Harrington es ausdrückt, Sie können Musik mit einer Geige aus Holz oder einer Geige, die mit einem 3D-Drucker hergestellt wurde, machen. Sie können einen Kohlefaserbogen oder einen aus Fernambukholz verwenden. Aber der Bogen muss noch über die Saiten gezogen werden. Die Musik "wird wertvoller, weil sie handgemacht ist."

Und das können vorerst nur wir. Die Maschinen brauchen uns vielleicht nicht mehr. Aber wenn es um den feierlichen Klang eines Bogens auf einer Violinsaite und die emotionalen Saiten geht, die an der Saite ziehen, brauchen wir die Maschinen nicht.

"Trevor Paglen: Sites Unseen", kuratiert von John Jacob, wird bis zum 6. Januar 2019 im Smithsonian American Art Museum in Washington, DC fortgesetzt. 2019.

* Anmerkung des Herausgebers, 2. November 2018: Diese Geschichte wurde überarbeitet, um die beabsichtigte Bedeutung und Herkunftsgeschichte von Steve Reichs "Different Trains" -Komposition zu verdeutlichen.