Es klingt wie eine Handlung von Black Mirror : Die Schüler werden gebeten, übereinstimmende Objekte zu identifizieren, aber wenn ein Roboter mit einer offensichtlich falschen Antwort hereinkommt, wiederholen einige Kinder, was der Bot wörtlich sagt, anstatt auf ihre eigenen Smarts zu tippen. Aber dies ist keine Science-Fiction - eine neue Studie in Science Robotics legt nahe, dass Kinder leicht dem Druck von Robotern erliegen.

Discovers Bill Andrews berichtet, dass ein Team aus deutschen und britischen Forschern 43 Kinder im Alter von 7 bis 9 Jahren für das Asch-Experiment rekrutiert hat, einen sozialen Konformitätstest, der sich als Sichtprüfung tarnt. Das Experiment, das erstmals in den 1950er Jahren entwickelt wurde, fordert die Teilnehmer auf, vier Linien zu vergleichen und die beiden übereinstimmenden Längen zu identifizieren. Es gibt eine offensichtlich richtige Antwort, da die Linien normalerweise sehr unterschiedlich lang sind und wenn die Kinder einzeln getestet wurden, lieferten sie in 87 Prozent der Fälle die richtige Antwort.

Sobald jedoch Roboter vor Ort waren, sanken die Punktzahlen auf 75 Prozent.

„Als die Kinder alleine im Raum waren, waren sie ziemlich gut in der Aufgabe, aber als die Roboter teilnahmen und falsche Antworten gaben, folgten sie einfach den Robotern“, sagte Tony Belpaeme, Co-Autor der Studie, ein Robotiker an der Universität von Plymouth im Vereinigten Königreich, erzählt James Vincent von The Verge.

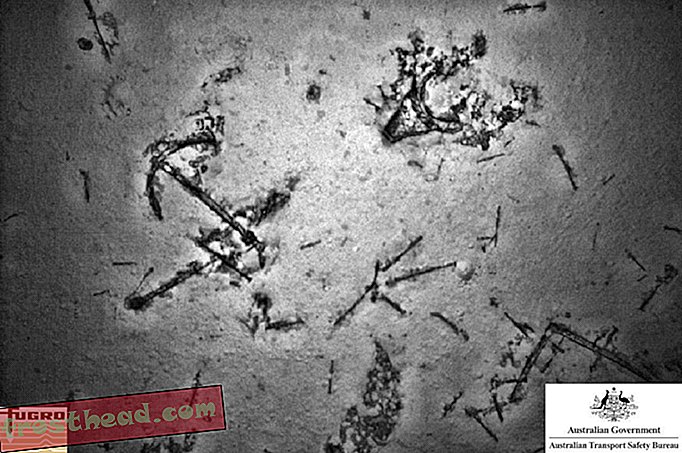

Hier abgebildet sind der verwendete Roboter, der Versuchsaufbau und der den Teilnehmern gezeigte „Sehtest“ (Vollmer et al.)

Hier abgebildet sind der verwendete Roboter, der Versuchsaufbau und der den Teilnehmern gezeigte „Sehtest“ (Vollmer et al.) In der neuen Testumgebung saß jeweils ein Freiwilliger neben drei humanoiden Robotern. Obwohl die zu bewertenden Linien nach wie vor gut unterscheidbar waren, zweifelten die Teilnehmer an sich selbst und suchten bei ihren Robotern nach Anleitungen. Von den falschen Antworten, die die Kinder gaben, stimmten 74 Prozent wörtlich mit denen der Roboter überein.

Alan Wagner, ein Luft- und Raumfahrtingenieur an der Pennsylvania State University, der nicht an der neuen Studie beteiligt war, sagt Carolyn Y. Johnson von der Washington Post, dass der unerbittliche Glaube, den Menschen oft an Maschinen setzen, als "Automatisierungsbias" bekannt ist.

„Die Leute glauben in der Regel, dass diese Maschinen mehr wissen als sie, dass sie ein größeres Bewusstsein haben als sie tatsächlich haben“, bemerkt Wagner. "Sie erfüllen sie mit all diesen erstaunlichen und phantasievollen Eigenschaften."

Vincent von The Verge schreibt, dass die Forscher den gleichen Test an einer Gruppe von 60 Erwachsenen durchgeführt haben. Im Gegensatz zu den Kindern hielten diese älteren Teilnehmer an ihren Antworten fest und weigerten sich, den (falschen) Schritten der Roboter zu folgen.

Das zurückhaltende Auftreten der Roboter könnte das mangelnde Vertrauen der erwachsenen Teilnehmer in sie beeinflusst haben, erklärt Belpaeme.

"Sie haben nicht genug Präsenz, um Einfluss zu haben", sagt er Vincent. "Sie sind zu klein, zu toylike."

Die Teilnehmer, die zum Abschluss der Prüfung befragt wurden, bestätigten die Theorie der Forscher und stellten fest, dass die Roboter nicht richtig funktionierten oder nicht weit genug fortgeschritten waren, um die richtige Antwort zu geben. Laut Belpaeme ist es möglich, dass sich Erwachsene bei einer Wiederholung der Studie mit eher autoritär aussehenden Robotern als genauso anfällig erweisen würden wie Kinder.

Laut einer Pressemitteilung haben die Ergebnisse des Teams weitreichende Auswirkungen auf die Zukunft der Roboterindustrie. Da „autonome soziale Roboter“ in den Bereichen Bildung und Kinderberatung immer häufiger auftreten, warnen die Forscher davor, dass Schutzmaßnahmen ergriffen werden sollten, um „das Risiko für Kinder während der Interaktion zwischen sozialem Kind und Roboter zu minimieren“.